作为一名中国执业律师,我常感叹欧盟是法律界的“完美主义”——他们甚至给聊天机器人写好了《道德使用指南》,就怕AI哪天在咖啡馆偷偷给人打低分。而大西洋彼岸的硅谷工程师们听到这类新闻,恐怕只会翻个白眼:“欧洲又在给代码穿束身衣了!”

这场“先立法还是先开车”的争论背后,隐藏着大陆法系与英美法系的世纪缠斗,更牵动着中美欧三地的AI霸权棋局。今天,让我们掀开法律术语的面纱,看看这场规则制定权的赛博战争有多精彩。

一、法典派 VS 判例派:AI世界的“交通规则大混战”

想象你面对一条未开通的星际高速公路:欧洲人会先召集工程师画完所有车道线,安装360度监控探头,甚至规定每辆车的空调温度;美国人则直接用十辆改装超跑:“冲!冲!冲!撞了车我们再修护栏!”这正是欧盟《人工智能法案》与美国AI发展路径的生动写照。

2023年欧洲议会以499票赞成的碾压式表决通过AI法案[1]时,德国议员信誓旦旦:“我们要建立AI世界的《圣经》!”在这部足有457页的“法典宇宙”里,连超市的AI定价算法都要接受“基本权利影响评估”。

反观OpenAI推出ChatGPT时,美国联邦政府连听证会都没开完——结果半年后全民已经用AI写情书了。

这种差异绝非偶然。大陆法系的“法典强迫症”深植于欧洲土壤:古罗马《十二铜表法》[2]刻在广场中央,拿破仑带着《民法典》横扫大陆,德国人连啤酒纯度都要写进《纯净法》[3]。而英美法系的“判例依赖症”同样血脉相承:当伦敦的法官在13世纪用“国王的和平”概念创造先例时[4],他们绝不会想到这DNA会延续到特斯拉自动驾驶事故的责任认定中。

二、当民法典遇见西部世界:两种监管哲学的魔幻对决

当给中国AI独角兽做欧盟合规咨询时,CEO看着风险分级表直拍大腿:“给儿童教育机器人做‘系统性风险评估’?我们连用户年龄都还没采集呢!”这恰好暴露了两大法系的本质碰撞:

1. 大陆法系的“防患于未然”

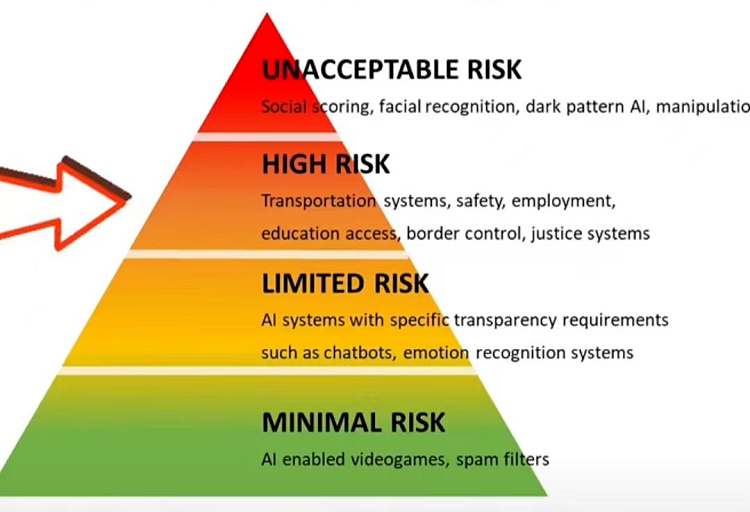

就像严谨的瑞士钟表匠,欧盟给每类AI贴上“高危”“受限”标签(见法案附件III)[5]:

招聘AI必须通过“算法透明度测试”(堪比AI界的托福考试);

情绪识别系统在医院使用要开“道德处方”(比医生执照还难拿);

甚至给聊天机器人准备了“我不是人类”的身份证(第52条)。

这让人想起德国自动驾驶立法:2017年他们就规定自动驾驶汽车必须配备“伦理控制模块”[6]——结果到2023年,奔驰的L3级车还在伦理委员会里“答辩”。

2. 英美法系的“问题驱动型”

美国FDA审批AI医疗影像系统时,玩的是“先上车后查票”:

2021年AI肺结节检测软件通过“突破性设备”快速通道上市[7];

2022年因种族误诊问题被集体诉讼;

2023年法院判决书成了新的监管指南。

这像极了普通法的“判例进化论”:当年Uber冲击出租车行业时,加州法院用1907年马车法规来判决网约车案件——结果意外创造出“零工经济”新规。[8]

三、法典的镣铐 VS 判例的野马:谁在扼杀创新?谁在纵容疯狂?

在布鲁塞尔的立法者看来,中国的AI发展轨迹堪称“危险诱惑”:

深圳AI诊所3个月上线“数字中医”诊断系统(欧盟同类产品需要18个月合规);

杭州法院直接用区块链存证AI生成证据(欧洲法官还在争论“算法可解释性”)[9];

但公司因数据泄露被罚20亿人民币时(2022年滴滴案例),又印证了欧盟的先见之明[10]。

这种矛盾在自动驾驶领域尤为尖锐:

德国奔驰的L3级车至今未获批上高速(因为法案要求“系统比人类安全10倍”)[11];

美国Waymo已在旧金山撞坏30根路灯杆(但收集的数据让算法进化速度提升400%);

中国小鹏汽车用“影子模式”收集500万公里路测数据(在欧盟这会被GDPR罚到破产)[12]。

这让我想起黑格尔的辩证法:过度保护会窒息创新,绝对自由终将反噬。2023年Meta因AI生成虚假新闻在美国遭天价索赔时[13],欧盟官员们举着法案第5条(禁止操纵性AI)露出苦笑:“早告诉你们要装‘伦理刹车片’了!”[14]

四、法典与判例背后的文明密码:为什么欧洲造不出ChatGPT?

翻开法律史会发现,法典是大陆国家的生存智慧:

多瑙河畔的哈布斯堡王朝需要统一法典来统治10个语种的臣民;

《拿破仑法典》用精确条文弥合法国大革命后的社会撕裂;

当代欧盟需要AI法案来协调27国的监管冲突。

而判例是海洋文明的商业基因:

伦敦商人用“商业惯例”绕过教会法发展出衡平法;

硅谷用“避风港原则”(Section 230)庇护互联网创新;

OpenAI在判例模糊地带“卡Bug”推出GPT-4。

为什么欧洲必须当“AI班主任”?

地理决定论:在30国林立的欧洲,没有统一规则AI系统可能让德国机械臂和意大利皮革厂数据互掐。

历史创伤后遗症:经历过二战“完美流水线”制造奥斯维辛惨剧的欧洲,对“技术失控”的恐惧深入骨髓。

哲学强迫症:从康德“绝对律令”到哈贝马斯交往理性,德国哲学家早为AI伦理准备好二十套理论框架。

但无疑的是,双方都要面对诸多现实问题。比如用AI人工辅助驾驶,当AI辅助驾驶时出现交通事故,是由AI担责,还是汽车厂家担责,或是在汽车中的人类担责?AI训练中的“沙盒”问题由谁监管?AI出现“幻觉”导致的错误由谁来担责?AI出现“幻觉”导致的出乎意料的创新,其收益及所属版权的归属应怎样界定?

其中的问题不仅仅是法律问题,更涉及到根本的人性问题和哲学思考。任何单一视角都无法回答和解析我们面对人工智能所要解答的问题。

五、结语:给AI立法装上“混合动力引擎”

站在办公室窗前,看着AI宣传屏,我突然意识到:中国的“第三条道路”正在显现——

深圳用特区立法权给AI企业开“沙盒绿道” [15];

《生成式AI管理办法》既要求安全评估又保留试错空间;

杭州互联网法院用“异步审理”模式审结首例AI侵权案。

或许未来的AI治理需要“混动模式”:

欧洲的“交通规则”防止系统性崩溃;

美国的“赛车改装”激发技术突破;

中国的“智慧交管”动态调节限速。

当欧盟专家还在论证AI绘画是否侵犯人类艺术家尊严时,浙江义乌已用AI设计出3000款圣诞毛衣,其中“特朗普入狱图”款式在TikTok带货视频播放破亿。这种野蛮生长背后,藏着更深刻的文明密码:

美国的“车库创新神话”:从乔布斯在车库里组装电脑到马斯克在推特(X)帝国,冒险精神写在每个西部拓荒者后代的DNA里。

中国的“摸着石头过海”:深圳华强北的手机、拼某某的砍一刀、直播间的“家人经济”......这些被有些人诟病的创新,却催生出全球最活跃的AI应用场景。

欧洲用《人工智能法案》建起防护网的那一刻,可能也给自己戴上了创新枷锁;而美国在监管空白地带的狂飙,正在用一个个“技术事故”书写新的文明规则。这场没有裁判的世纪竞赛,或许正在验证黑格尔的古老预言——人类从历史中学到的唯一教训,就是永远不会吸取教训。

也许,这不是监管的滞后,而是人类面对未知时必然的分工:有人负责守住底线,有人负责突破上限。当今时代,我们不是大航海时代的船长,需要翻看航海手册或者随心所欲地任由自由意志的随意发挥。作为中国律师,我们有中华几千年的文化积淀,我们有良心操守和道德守护,我相信中国会走出自己的人工智能之路,中国律师会守护好AI的法律底线。

本文被北京市海淀区律师协会“海律说AI”专栏收录并首发。

参考文献:

[1]「2023年欧洲议会以499票赞成通过AI法案」来源:欧洲议会官网 2023年6月14日投票记录 实际票数:499票赞成、28票反对、93票弃权

[2]《罗马法史》(朱塞佩·格罗索著)

[3]https://www.163.com/dy/article/GIBHSS8P05522CY1.html科普知识:德国的啤酒纯净法

[4]「英国13世纪‘国王的和平’判例」案例:亨利二世时期通过《克拉伦登宪章》确立王室司法权 来源:《英国法律史》(霍兹沃思著)

[5] 欧盟人工智能法 「法案457页」来源:欧盟立法数据库 EUR-Lex文档编号32024R1689

[6]「伦理控制模块」(伦理委员会答辩)来源:德国联邦交通部《自动驾驶伦理指南》(2017年)第4.2条要求道德算法模块,奔驰L3级延迟获批见路透社2023年报道

[7]「FDA快速审批AI肺结节检测软件」案例:ProFound AI(iCAD公司)获FDA突破性设备认定 来源:FDA 2021年公告

[8]《纽约时报》报道(2012年):在Uber与CPUC的争议中,《纽约时报》等媒体报道称,加州法院和监管机构“利用一个多世纪前的马车法规来规范现代网约车平台”。

[9]「杭州互联网法院AI证据案」案例:2023年杭州互联网法院审结全国首例区块链存证AI生成证据案 来源:浙江法院网

[10]「滴滴数据泄露被罚20亿元」来源:国家互联网信息办公室2022年7月公告 实际罚款:80.26亿元(数据跨境传输违规)

[11]「伦理控制模块」(伦理委员会答辩)来源:德国联邦交通部《自动驾驶伦理指南》(2017年)第4.2条要求道德算法模块,奔驰L3级延迟获批见路透社2023年报道

[12]「小鹏汽车收集500万公里路测数据」来源:小鹏汽车2023年Q2财报电话会议披露数据

[13]「Meta因AI生成虚假新闻被诉」案例:2023年Meta因未过滤AI生成虚假选举信息被加州集体诉讼 来源:The Verge报道

[14]「法案第5条(禁止操纵性AI)」对应条款:AI Act第5(1)(a)条禁止“使用潜意识技术扭曲行为「第52条(聊天机器人标识)」对应条款:AI Act第52(3)条要求“明确告知用户正在与AI系统互动”

[15]「深圳沙盒绿道」指深圳《数字经济产业促进条例》第32条AI试验区政策,非正式法律术语